Os pipelines de machine learning são fundamentais para otimizar o fluxo de trabalho em projetos de aprendizado de máquina. Eles permitem automatizar, organizar e monitorar cada etapa desde a coleta de dados até a implementação do modelo, garantindo uma abordagem sistemática e eficiente para a solução de problemas complexos. Neste artigo, exploraremos em profundidade como construir e gerenciar esses pipelines.

O que são Pipelines de Machine Learning

O que são Pipelines de Machine Learning

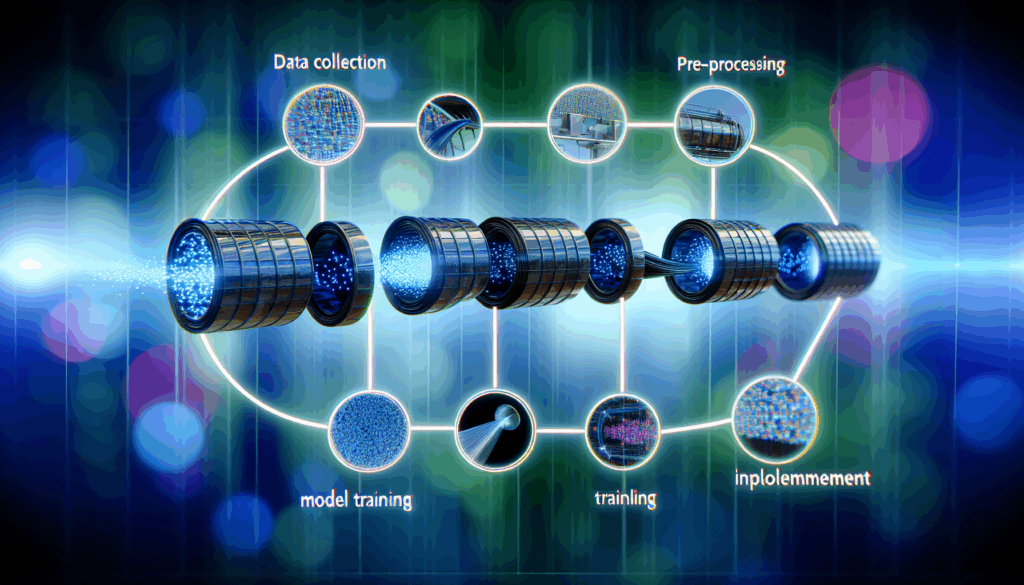

Pipelines de Machine Learning são estruturas fundamentais que organizam e sistematizam o fluxo de trabalho em projetos de aprendizado de máquina. Essas estruturas consistem em uma série de etapas sequenciais que, quando seguidas, garantem a eficiência, a reprodutibilidade e a escalabilidade dos projetos de machine learning. A importância dos pipelines não pode ser subestimada, pois eles não apenas facilitam o gerenciamento do fluxo de trabalho, mas também asseguram que cada aspecto do modelo seja abordado de maneira sistemática e bem estruturada.

Cada etapa do pipeline desempenha um papel crítico no sucesso final do modelo. Desde a coleta de dados até a implementação do modelo, cada fase é interconectada, e a falha em qualquer uma delas pode comprometer todo o processo. Por exemplo, se a coleta de dados não for realizada corretamente, todos os esforços subsequentes de pré-processamento ou modelagem serão em vão. Assim, as pipelines tornam-se vitais para garantir que todos os elementos do projeto sejam conduzidos de forma coesa e integrada.

Etapas do Pipeline de Machine Learning

As etapas básicas em um pipeline de machine learning incluem:

1. **Coleta de Dados**: Esta é a fase inicial onde dados relevantes são reunidos. A qualidade e a abrangência dos dados coletados devem ser priorizadas, pois esses dados serão a base para o treinamento do modelo. A coleta pode envolver a exploração de fontes variadas, como bancos de dados, APIs ou dados gerados por sensores.

2. **Pré-processamento**: Nesta etapa, os dados brutos são preparados para análise. Isso pode incluir a limpeza dos dados (remoção de valores ausentes, duplicatas e outliers), normalização e transformação para garantir que os dados estejam em um formato apropriado para o modelo. Um pré-processamento eficaz é crucial, pois dados mal preparados podem introduzir viés e erros nos resultados do modelo.

3. **Seleção de Características**: Após o pré-processamento, a escolha das características mais relevantes que serão utilizadas no modelo é realizada. Essa seleção é crítica, pois a utilização de características irrelevantes pode prejudicar o desempenho do modelo e aumentar o tempo de treinamento. Métodos como análise de variância, regressão e técnicas de aprendizado de máquina, como árvores de decisão, podem ser utilizados para identificar as características mais impactantes.

4. **Treinamento do Modelo**: Com os dados preparados e as características selecionadas, inicia-se o treinamento do modelo. Esta etapa envolve a escolha de algoritmos adequados e a configuração de hiperparâmetros. É durante esta fase que o modelo aprende a partir dos dados, ajustando-se para minimizar a função de perda e maximizar a precisão das previsões.

5. **Avaliação**: A validação do modelo ocorre após o treinamento. O desempenho do modelo é testado em um conjunto de dados separado, e métricas como acurácia, precisão, recall e F1 score são calculadas. A avaliação é crucial, pois permite identificar se o modelo está generalizando bem para dados que não viu antes ou se está sofrendo de overfitting.

6. **Implementação**: Por fim, após a validação bem-sucedida do modelo, ele é implementado em um ambiente de produção. Essa fase envolve a integração do modelo em sistemas existentes, garantindo que ele possa ser utilizado para fazer previsões em tempo real ou para processar novos dados conforme eles se tornam disponíveis.

Interações entre as Etapas

A interação entre essas etapas é o que torna um pipeline de machine learning eficiente. Por exemplo, a fase de avaliação pode levar à necessidade de revisitar o pré-processamento para corrigir aspectos que não foram abordados adequadamente ou para considerar outras características que podem melhorar o desempenho do modelo. Essa iteração é uma parte natural do processo e demonstra a necessidade de um pipeline flexível.

Além disso, a automação de várias dessas etapas proporciona um aumento substancial da eficiência. Ferramentas e frameworks como Apache Airflow, MLflow e Kubeflow permitem que os profissionais de machine learning automatizem fluxos de trabalho inteiros, diminuindo a quantidade de tarefas manuais e aumentando a consistência dos resultados. A automação não apenas economiza tempo, mas também reduz a probabilidade de erro humano ao executar tarefas repetitivas.

Exemplos de Aplicações Práticas

Pipelines de machine learning são utilizados em diversas indústrias. Em finanças, por exemplo, um pipeline pode ser empregado na detecção de fraudes, onde a coleta de dados inclui transações e perfis de clientes, seguida de pré-processamento para remover inconsistências e, após a seleção de características, o treinamento de um modelo que identifica comportamentos suspeitos. Da mesma forma, na área da saúde, modelos preditivos podem ajudar na previsão de surtos de doenças, seguindo etapas que vão da coleta de dados demográficos até a implementação de modelos que ajudem na alocação eficiente de recursos.

Com a complexidade crescente dos modelos de machine learning, entender e construir pipelines eficientes se tornou uma competência essencial. Para aqueles que desejam se aprofundar mais nesse assunto e em várias outras áreas relacionadas à ciência de dados, o curso Elite Data Academy é uma excelente opção. Nele, você poderá desenvolver habilidades práticas e teóricas em analytics, data science e engenharia de dados. Inscreva-se hoje e comece sua jornada para se tornar um especialista em dados: [Elite Data Academy](https://paanalytics.net/elite-data-academy/?utm_source=BLOG).

Assim, compreendendo a importância e a estrutura dos pipelines de machine learning, podemos apreciar a complexidade que está por trás do sucesso dos modelos preditivos e como cada interação entre as etapas desempenha um papel vital no resultado final.

Estrutura de um Pipeline de Machine Learning

Estrutura de um Pipeline de Machine Learning

A construção eficiente de um pipeline de Machine Learning (ML) exige uma compreensão clara das diversas etapas envolvidas no processo. Cada etapa é interdependente, contribuindo de maneira significativa para o desempenho do modelo final. Vamos explorar as principais fases do pipeline de ML: coleta de dados, pré-processamento, seleção de características, treinamento do modelo, avaliação e implementação.

1. Coleta de Dados

A coleta de dados é a primeira e uma das mais críticas etapas do pipeline de ML. Aqui, o objetivo é reunir dados de qualidade que serão utilizados para treinar e testar o modelo. Os dados podem vir de diversas fontes, como bancos de dados internos, APIs, arquivos CSV, web scraping e até mesmo sensores IoT. A escolha da fonte de dados impacta diretamente a qualidade e a quantidade de informações disponíveis para o treinamento.

Sendo assim, é fundamental pesquisar e entender os requisitos do problema em questão, já que dados inadequados ou escassos podem levar a um modelo ineficaz. Durante a coleta, também é importante garantir que os dados sejam representativos do problema a ser resolvido, o que pode incluir a consideração de diferentes segmentos da população, a diversidade de variáveis e a relevância das informações obtidas.

2. Pré-processamento

Uma vez que os dados são coletados, o próximo passo é o pré-processamento. Essa etapa envolve diversas técnicas destinadas a preparar os dados brutos para análise. Os principais processos de pré-processamento incluem:

– **Limpeza de Dados**: Remoção de duplicatas, tratamento de valores ausentes e correção de erros. Dados sujos podem comprometer seriamente o aprendizado do modelo.

– **Transformação de Dados**: Conversão de variáveis categóricas em numéricas, normalização e padronização dos dados. Essas transformações são importantes para garantir que diferentes variáveis possam ser comparadas adequadamente.

– **Divisão de Dados**: Usualmente, os dados são divididos em conjuntos de treino e teste (e, em alguns casos, um conjunto de validação). Essa separação é essencial para avaliar o desempenho do modelo de forma imparcial.

Um pré-processamento cuidadoso garante que o modelo tenha acesso a dados de alta qualidade, aumentando a probabilidade de resultados precisos e confiáveis.

3. Seleção de Características

Após o pré-processamento, a próxima fase é a seleção de características (feature selection). Nessa etapa, é essencial identificar quais variáveis são mais relevantes para o problema que está sendo resolvido. O objetivo aqui é eliminar características redundantes ou irrelevantes que podem causar overfitting ou aumentar o tempo de treinamento sem contribuir significativamente para o desempenho.

A seleção de características pode ser realizada de várias maneiras, incluindo:

– **Métodos Baseados em Filtro**: Avaliam a correlação de cada variável com a variável alvo e selecionam as mais fortes.

– **Métodos Baseados em Envoltório**: Utilizam algoritmos de aprendizado para selecionar características que melhoram o modelo, como a busca recursiva de características.

– **Métodos Baseados em Embedding**: Incorpoçam a seleção de características durante o processo de treinamento do modelo, como é o caso de alguns algoritmos de árvore de decisão.

Uma seleção de características eficaz pode aumentar a interpretabilidade do modelo, reduzir o tempo de treinamento e melhorar o desempenho geral.

4. Treinamento do Modelo

Com os dados prontos e as características selecionadas, a próxima etapa é o treinamento do modelo. Aqui, algoritmos de Machine Learning são aplicados aos dados de treino para criar um modelo preditivo. O tipo de algoritmo escolhido dependerá do tipo de problema (classificação, regressão, etc.) e das características dos dados.

Durante o treinamento, é fundamental monitorar métricas de desempenho, como a acurácia, precisão e recall, dependendo do tipo de tarefa que o modelo está realizando. Vale lembrar que um treinamento adequado pode incluir ajustes de hiperparâmetros para otimizar o desempenho do modelo.

Esta fase é onde as interações entre as etapas anteriores começam a refletir em um modelo de aprendizado de máquina. Problemas menores, como dados não limpos ou características não selecionadas corretamente, podem comprometer a eficácia do modelo durante essa fase.

5. Avaliação

Após o treinamento, precisamos avaliar o modelo para entender sua capacidade preditiva. A avaliação deve ser feita utilizando dados que não foram vistos pelo modelo durante o treinamento (dados de teste). Isso garante que a performance medida seja representativa do desempenho real do modelo em situações do mundo real.

Diversas métricas podem ser usadas para avaliação, como:

– **Acurácia**: Proporção de previsões corretas em relação ao total de previsões.

– **Precisão e Recall**: Especialmente úteis em conjuntos de dados desbalanceados para avaliar a eficácia do modelo na identificação de classes importantes.

– **F1-Score**: Métrica que combina precisão e recall, oferecendo uma visão mais equilibrada.

A avaliação crítica ajuda a identificar áreas de melhoria e pode levar a decisões sobre ajustes necessários nas etapas anteriores, como re-treinamento ou revisões na seleção de características.

6. Implementação

A fase final é a implementação do modelo no ambiente de produção. Isso envolve garantir que o modelo funcione de forma eficiente e sem problemas em tempo real. As considerações de implementação incluem escalabilidade, segurança e integração com sistemas existentes.

Além disso, é vital monitorar o desempenho do modelo após a implementação. O comportamento dos dados pode mudar com o tempo (um fenômeno conhecido como drift), o que pode exigir reavaliação e re-treinamento do modelo para manter sua performance.

O sucesso de um projeto de Machine Learning está diretamente ligado a quão bem cada uma dessas etapas é executada e integrada ao pipeline. Para se aprofundar no aprendizado sobre essas etapas e como implementá-las de forma eficiente, considere explorar o curso [Elite Data Academy](https://paanalytics.net/elite-data-academy/?utm_source=BLOG). Este curso oferece uma visão abrangente sobre análise de dados, ciência de dados e engenharia de dados, capacitando você a construir pipelines de ML mais eficazes e otimizados.

Ferramentas e Tecnologias para Construir Pipelines

ferramentas e tecnologias para construir pipelines

Na construção de pipelines de machine learning, a escolha das ferramentas e tecnologias adequadas é fundamental para otimizar as diversas etapas do processo, desde a coleta de dados até a implementação do modelo em produção. Com um ambiente tecnológico em constante evolução, explorar as melhores opções disponíveis não apenas aumenta a produtividade, mas também melhora a qualidade dos resultados obtidos. Este capítulo apresentará as principais ferramentas e tecnologias que ajudam na construção de pipelines de machine learning, assim como a importância de sua escolha criteriosa.

Frameworks de Automação

Uma das primeiras considerações ao construir um pipeline de machine learning é o uso de frameworks de automação. Esses frameworks permitem que os profissionais implementem, monitorem e gerenciem suas tarefas de aprendizado de máquina de forma eficiente. Algumas das ferramentas mais populares incluem:

– **Apache Airflow**: Uma plataforma de programação para criar, agendar e monitorar fluxos de trabalho complexos. O Airflow é especialmente útil para gerenciar pipelines que exigem a execução de tarefas em sequência e a manipulação de dependências.

– **Kubeflow**: Uma ferramenta projetada para facilitar o trabalho com machine learning em uma arquitetura de Kubernetes. O Kubeflow permite a criação, treinamento e implantação de modelos de machine learning em cluster, garantindo escalabilidade e eficiência.

– **MLflow**: Um framework open-source que oferece uma plataforma para gerenciar o ciclo de vida do aprendizado de máquina. Com recursos para rastreamento de experimentos, gerenciamento de projetos e repositórios de modelos, o MLflow facilita a colaboração e a reprodutibilidade dos resultados.

Essas ferramentas oferecem uma estrutura sólida e flexível para gerenciar processos de machine learning, além de permitir uma integração mais fácil com outras tecnologias.

Bibliotecas Populares

Além dos frameworks de automação, as bibliotecas de programação são essenciais para a construção eficaz de pipelines. Aqui estão algumas das bibliotecas mais utilizadas e suas funções:

– **Pandas**: Uma biblioteca poderosa para a manipulação de dados, fundamental na etapa de pré-processamento. O Pandas permite operações rápidas de limpeza e transformação de dados, tornando-o uma escolha popular entre os cientistas de dados.

– **Scikit-learn**: Uma das bibliotecas mais amplamente utilizadas para aprendizado de máquina em Python. Ela oferece uma ampla gama de algoritmos para classificação, regressão e clustering, além de ferramentas para seleção de características e validação de modelos.

– **TensorFlow e PyTorch**: Ambas as bibliotecas são amplamente utilizadas para a construção de modelos de aprendizado profundo. Enquanto o TensorFlow é conhecido por sua robustez e escalabilidade, o PyTorch tem ganhado popularidade devido à sua facilidade de uso e flexibilidade, especialmente em pesquisa.

Escolhendo as Ferramentas Certas

A seleção das ferramentas adequadas para cada etapa do pipeline de machine learning pode impactar significativamente o desempenho e a eficiência do processo. A escolha deve considerar a complexidade do projeto, a experiência da equipe e as especificidades do problema a ser resolvido.

A seguir, discutiremos a importância de alinhar as ferramentas às etapas do pipeline:

– **Coleta de Dados**: A escolha de ferramentas de coleta de dados pode influenciar a qualidade e a quantidade de informações disponíveis para o treinamento do modelo. Ferramentas como Apache Kafka e Scrapy são populares nesta fase.

– **Pré-processamento**: Nesta etapa, o uso de bibliotecas como Pandas e NumPy é prevalente. A eficiência aqui determina quão bem o modelo irá desempenhar após o treinamento. A capacidade de manipular dados sem incorrer em grandes penalidades de desempenho é crucial.

– **Treinamento do Modelo**: A escolha entre TensorFlow e PyTorch pode depender do conjunto de dados, da arquitetura do modelo e das exigências de desempenho. Avaliar as vantagens e desvantagens de cada uma em relação ao projeto específico é fundamental.

– **Avaliação e Implementação**: Ferramentas como MLflow não apenas ajudam na avaliação do modelo, mas também na sua implementação. A capacidade de monitorar o modelo em produção é uma vantagem que não deve ser subestimada.

A decisão sobre quais ferramentas usar deve ser estratégica, almejando sempre a aplicação mais eficaz de cada uma delas.

Impacto na Produtividade e Qualidade dos Resultados

A escolha das ferramentas certas não afeta apenas a eficiência do trabalho, mas também a qualidade dos resultados finais. Uma infraestrutura bem escolhida pode salvar tempo e recursos, permitindo que os cientistas de dados se concentrem mais no desenvolvimento de modelos e na análise de resultados.

Por exemplo, o uso de ferramentas de automação permite que equipes invistam menos tempo em tarefas repetitivas e mais tempo em experimentação e inovação. A correlação entre a eficiência das ferramentas e a qualidade dos resultados é inegável. Um pipeline bem integrado resulta em melhores modelos, o que, por sua vez, se traduz em decisões mais precisas e confiáveis.

Portanto, é essencial que as organizações analisem e escolham suas ferramentas com cuidado, considerando a cultura da equipe, os objetivos do projeto e a integração necessária com sistemas existentes.

Para quem deseja se aprofundar mais nos tópicos de ferramentas e tecnologias para pipelines de machine learning, recomendamos o curso da [Elite Data Academy](https://paanalytics.net/elite-data-academy/?utm_source=BLOG). Este curso fornece conhecimentos valiosos sobre análise de dados, ciências de dados e engenharia de dados, preparando você para dominar a construção de pipelines eficientes e eficazes.

As ferramentas e tecnologias certas podem fazer toda a diferença na implementação de um pipeline de machine learning, e entendê-las profundamente permitirá que você atinja resultados extraordinários em seus projetos.

Desafios na Implementação de Pipelines de Machine Learning

Desafios na Implementação de Pipelines de Machine Learning

A implementação de pipelines de machine learning envolve uma série de desafios que podem afetar a eficiência e a eficácia do modelo ao longo do tempo. Desde o gerenciamento de dados até a manutenção do modelo, compreender e abordar esses desafios é fundamental para garantir que o pipeline funcione de maneira otimizada. Este capítulo explora esses principais desafios, juntamente com estratégias para superá-los, fornecendo uma visão abrangente das complexidades associadas à implementação de pipelines de machine learning.

**Gerenciamento de Dados**

Um dos desafios mais significativos no desenvolvimento de pipelines é o gerenciamento de dados. A qualidade e a relevância dos dados utilizados diretamente influenciam o desempenho do modelo. Existem várias questões a serem consideradas:

1. **Aquisição de Dados**: Obter dados de múltiplas fontes pode ser um processo complicado, especialmente quando essas fontes estão em formatos diversos ou quando exigem integração em tempo real. Ferramentas de ETL (extração, transformação e carregamento) podem ser úteis nesse processo, mas é crucial assegurar que elas sejam configuradas corretamente para lidar com os dados em diferentes estágios de qualidade.

2. **Limpeza de Dados**: Dados brutos muitas vezes contêm ruídos que precisam ser eliminados para que o modelo seja eficaz. Isso inclui lidar com valores ausentes, inconsistências e outliers. Uma abordagem sistemática para a limpeza de dados pode envolver a criação de regras que validem a integridade e a precisão dos dados.

3. **Armazenamento e Acesso**: Com o aumento do volume de dados, o armazenamento correto e a eficiência no acesso aos dados são críticos. Soluções como bancos de dados escaláveis e armazenamento em nuvem ajudam a gerenciar grandes conjuntos de dados, mas exigem um planejamento cuidadoso para otimizar a performance.

**Integração de Sistemas**

A integração de sistemas é outro aspecto crucial que pode representar uma barreira significativa na implementação de pipelines de machine learning. Frequentemente, diferentes partes de uma organização usam diversas tecnologias e plataformas de dados, tornando desafiadora a tarefa de consolidar essas informações em um processo coeso.

A interoperabilidade entre ferramentas e sistemas é essencial para um pipeline eficiente. Aqui estão algumas considerações:

1. **APIs e Conectores**: A utilização de APIs (Application Programming Interfaces) pode facilitar a conexão entre diferentes sistemas, permitindo que os dados fluam de maneira transparente através do pipeline. A criação de conectores robustos e a escolha de APIs bem documentadas são vitais para minimizar problemas de integração.

2. **Padrões de Dados**: A adoção de padrões de dados comuns entre sistemas pode simplificar a integração e garantir que as informações sejam compreendidas de maneira consistente. Investir na normalização dos dados desde o início pode prevenir retrabalhos futuros.

3. **Eventos em Tempo Real**: A implementação de arquitetura orientada a eventos pode permitir que os dados sejam processados em tempo real, enviando informações instantaneamente para o pipeline assim que surgem. Isso exige uma consideração cuidadosa da infraestrutura capaz de suportar a carga e o volume contínuo de operações.

**Manutenção do Modelo**

Após a implantação inicial do modelo, sua manutenção se torna um desafio contínuo. Um modelo que funciona bem em um ambiente de teste pode apresentar desempenho inferior na produção devido a mudanças nas condições de dados ou no ambiente operacional. As estratégias a seguir podem ajudar a mitigar esses problemas:

1. **Monitoramento Contínuo**: Implementar ferramentas de monitoramento que rastreiem o desempenho do modelo em tempo real é fundamental. Agendas de testes automatizados e relatórios de métricas de performance são ferramentas indispensáveis para detectar anomalias e ajustes necessários.

2. **Reinício de Modelos**: Em muitos casos, a atualização do modelo é necessária para manter a relevância das previsões. Estabelecer um ciclo de vida claro para a reavaliação e atualização do modelo, com intervalos regulares de revisão, pode ajudar a manter a acurácia ao longo do tempo.

3. **Documentação e Treinamento**: A rotatividade de equipe e o conhecimento coletivo são fatores que podem impactar a manutenção do modelo. Documentar todos os processos e decisões tomadas durante o desenvolvimento do pipeline facilita a transferibilidade do conhecimento e proporciona uma base sólida para novos membros da equipe.

**Estratégias para Superar os Desafios**

Além de abordar os desafios mencionados, existem abordagens estratégicas que podem ser implementadas para garantir um pipeline de machine learning eficiente:

– **Automação de Processos**: A automação é essencial para reduzir erros humanos e aumentar a eficiência. A utilização de frameworks de automação pode aliviar a carga de tarefas repetitivas, permitindo que as equipes foquem em atividades de maior valor agregado.

– **Backups e Recuperação de Dados**: Manter cópias de segurança regulares dos dados e modelos é vital para garantir a continuidade do funcionamento do pipeline em caso de falhas no sistema. Um plano de recuperação bem estruturado pode influencer diretamente na resiliência do processo.

– **Colaboração Interdisciplinar**: Envolver equipes de diferentes áreas, como TI, ciência de dados e negócios, ajuda a garantir que todos os aspectos do pipeline sejam considerados. O trabalho colaborativo pode resultar em melhor alinhamento das expectativas e prioridades, facilitando a execução.

Essas práticas não apenas ajudam a suavizar os desafios enfrentados na implementação de pipelines de machine learning, mas também podem abrir portas para melhorias inovadoras que potencializam ainda mais o desempenho dos modelos.

Para obter um entendimento mais profundo sobre como estruturar eficientemente processos de aprendizado de máquina e dominar esses desafios, considera-se valioso explorar o curso oferecido pela Elite Data Academy. Através de conteúdos ricos sobre ciência de dados, engenharia de dados e análise, é possível desenvolver habilidades práticas que capacitam profissionais para enfrentar os desafios modernos do mercado. Você pode conhecer mais sobre este curso acessando o site [Elite Data Academy](https://paanalytics.net/elite-data-academy/?utm_source=BLOG) e, assim, aprimorar seu conhecimento e sua carreira na área.

Futuro dos Pipelines de Machine Learning

Futuro dos Pipelines de Machine Learning

À medida que a tecnologia avança, os pipelines de machine learning começam a se redefinir, adaptando-se às novas demandas e potencializando as oportunidades que surgem. O futuro dos pipelines de machine learning se apresenta promissor, marcado por tendências que influenciam a automação, a eficiência e a integração de inteligência artificial nos processos. Neste capítulo, examinaremos essas evoluções e o que elas significam para diversos setores.

**Tendências de Automação**

A automação tem sido uma força transformadora em muitos aspectos da tecnologia, e os pipelines de machine learning não são uma exceção. Com o crescimento exponencial dos dados, a necessidade de sistemas que possam automatizar a coleta, o pré-processamento e a análise se torna evidente. Ferramentas como AutoML (Automated Machine Learning) estão ganhando destaque, permitindo que usuários com pouca experiência em ciência de dados construam modelos eficazes. Essa automação minimiza a necessidade de intervenção manual em tarefas repetitivas, o que não só acelera o tempo de execução, mas também reduz a probabilidade de erros.

Além disso, a automação facilita a manutenção contínua do modelo, permitindo re-treinamentos automáticos à medida que novos dados se tornam disponíveis. Os pipelines podem ser configurados para verificar periodicamente a performance do modelo e, ao detectar degradação, acionar um novo treinamento automaticamente.

**Inteligência Artificial para Otimização de Processos**

Outra grande expectativa futura dos pipelines é o uso crescente de inteligência artificial para otimização de processos. A implementação de métodos de aprendizado de máquina para melhorar a própria máquina é uma tendência que deverá se expandir. Por exemplo, algoritmos de aprendizado por reforço podem ser aplicados para otimizar a arquitetura do pipeline, identificando quais etapas do processo mais contribuem para a eficiência.

Esses processos podem incluir desde a escolha das melhores fontes de dados até configurações de hiperparâmetros para modelagem. A expectativa aqui é que, à medida que a inteligência artificial se torna cada vez mais experiente, os pipelines não apenas automatizem, mas também melhorem proativamente a sua eficiência ao longo do tempo, adaptando-se rapidamente a novas variáveis e mudanças nas condições de operação.

**Desafios e Oportunidades**

Entretanto, essa evolução não é isenta de desafios. O aumento da automação e da complexidade dos pipelines pode gerar uma nova onda de desafios em sua implementação e gestão. A integração de múltiplas ferramentas e plataformas que utilizam inteligência artificial exigirá uma governança robusta e protocolos de segurança rigorosos. As empresas precisarão garantir que a automação não comprometa a qualidade dos dados ou a integridade dos modelos de machine learning.

No entanto, esses desafios também trazem oportunidades enormes para as indústrias. Setores como financeiro, saúde e produção já estão experimentando mudanças significativas em suas operações devido ao uso de pipelines avançados de machine learning. Por exemplo, na medicina, algoritmos que analisam grandes conjuntos de dados podem auxiliar na detecção precoce de doenças, enquanto no setor financeiro, sistemas de detecção de fraudes se beneficiam de modelos preditivos refinados.

**Impacto nas Indústrias**

Os pipelines de machine learning estão se tornando fundamentais nas operações de diversas indústrias. No varejo, por exemplo, eles permitem uma análise mais precisa do comportamento do consumidor, personalizando experiências e otimizando estoques. Isso resulta em uma abordagem mais proativa para atender às necessidades dos clientes, aumentando a satisfação e a fidelidade.

Na indústria automotiva, pipelines de machine learning estão sendo usados para otimizar processos de produção, prever falhas de equipamentos e desenvolver veículos inteligentes. A resolução matemática de problemas complexos, como otimização de rotas em tempo real, demonstra como essa tecnologia pode revolucionar experiências e operações.

Na saúde, a capacidade de analisar vastas quantidades de dados em tempo real não só melhora os diagnósticos, mas também personaliza tratamentos, atendendo melhor as especificidades de cada paciente. O uso de machine learning na pesquisa farmacêutica acelera o desenvolvimento de novos medicamentos, reduzindo o tempo e o custo envolvidos.

**Capacitação e Aprendizado Contínuo**

Para acompanhar essas tendências e mudanças no ambiente de machine learning, a capacitação contínua se torna crucial. Profissionais que atuam nesse campo precisam se adaptar rapidamente às novas ferramentas e metodologias. Programas de educação focados em ciência de dados, como a Elite Data Academy, são essenciais para manter a competitividade no mercado. Com uma variedade de cursos que cobrem desde análise de dados até engenharia de dados e aprendizado de máquina, a academia oferece uma oportunidade valiosa para aqueles que desejam aprimorar suas habilidades e se destacar em um mercado saturado.

A Elite Data Academy é especialmente recomendada para quem está buscando aprofundar conhecimentos em machine learning e entender como essa tecnologia pode ser integrada de maneira eficiente dentro dos pipelines de dados. Ao investir no aprendizado e na aplicação prática, é possível não apenas navegar com sucesso nas incertezas do futuro, mas também se tornar um agente de mudança nas próprias organizações.

Todas essas tendências e inovações apontam para um futuro onde os pipelines de machine learning serão mais automatizados, otimizados e integrados. Essa evolução não só transformará a maneira como os dados são tratados, mas também como as empresas operam, oferecendo ao mercado condições para explorarem novas frentes e aprimorarem suas estratégias de negócio.

Conclusions

Concluindo, os pipelines de machine learning desempenham um papel crucial na estruturação eficiente de projetos de aprendizado de máquina. Ao aplicar as melhores práticas e tecnologias disponíveis, é possível superar desafios e alcançar resultados significativos. Com a evolução constante das ferramentas e metodologias, o futuro promete ainda mais inovações nesse campo.